Europees Parlement stemt vóór AI-wet

Een overgrote meerderheid van het Europees Parlement heeft de AI-wetgeving goedgekeurd. De wet heeft als doel de rechten, van burgers te beschermen maar tegelijkertijd de ontwikkeling van AI te stimuleren.

De verordening, waarover de EU-landen overeenstemming bereikten in december 2023, werd door de EP-leden goedgekeurd met 523 stemmen voor, 46 tegen en bij 49 onthoudingen.

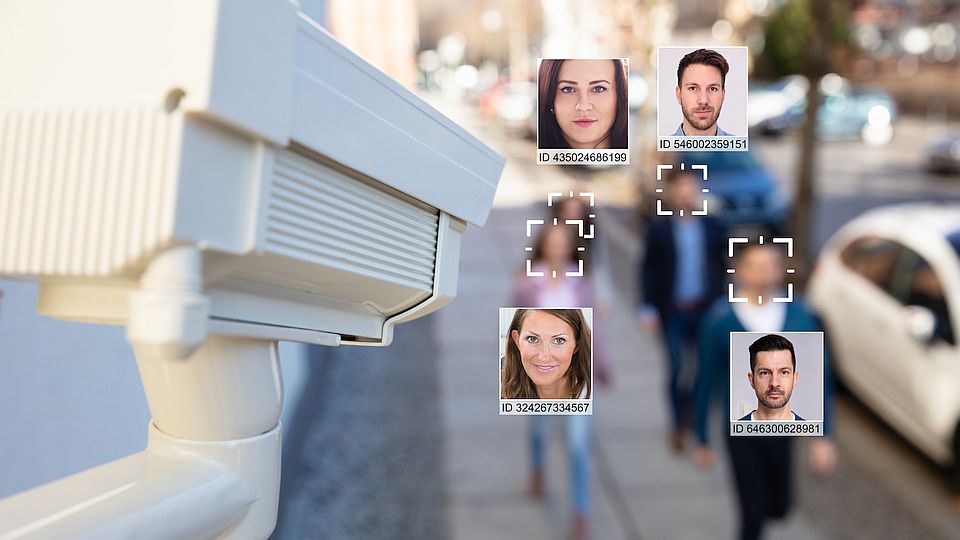

Met de verordening komen er verplichtingen voor AI-systemen op basis van de potentiële risico’s en gevolgen die ze met zich meebrengen. Bepaalde AI-toepassingen die de rechten van burgers in gevaar brengen, worden verboden. Denk daarbij aan systemen voor biometrische categorisering op basis van gevoelige kenmerken, of aan de ongerichte scraping van gezichtsafbeeldingen van het internet of CCTV-beelden om databanken voor gezichtsherkenning aan te leggen. Daarnaast komt er een verbod op emotieherkenning op het werk en op school. Hetzelfde geldt voor burgerscores, voorspellend politiewerk dat uitsluitend is bedoeld om mensen te profileren of hun kenmerken te beoordelen, en AI waarmee menselijk gedrag wordt gemanipuleerd of de kwetsbaarheden van mensen worden uitgebuit.

Vrijstellingen

Het gebruik van systemen voor biometrische identificatie op afstand (RBI) door rechtshandhavingsinstanties wordt in beginsel verboden. Alleen in limitatief opgesomde en nauwkeurig omschreven omstandigheden kan hiervan worden afgeweken. RBI-systemen mogen alleen in real time worden ingezet als aan strikte waarborgen wordt voldaan. Zo mogen ze alleen tijdens een beperkte periode en binnen een beperkt geografisch gebied worden gebruikt en moet de rechter of de administratie vooraf specifieke toestemming hebben gegeven. Deze systemen kunnen bijvoorbeeld worden gebruikt om gericht te zoeken naar een vermiste persoon of om terroristische aanslagen te voorkomen. RBI-systemen die achteraf worden ingezet (“RBI achteraf”), worden beschouwd als systemen met een hoog risico. De toestemming van de rechter moet in zulke gevallen verband houden met een strafbaar feit.

Verplichtingen

Ook worden er duidelijke verplichtingen ingevoerd voor andere AI-systemen met een hoog risico. Deze kunnen namelijk schade toebrengen aan de gezondheid, de veiligheid, de grondrechten, het milieu, de democratie en de rechtsstaat. AI-systemen met een hoog risico worden onder meer gebruikt op het gebied van kritieke infrastructuur, onderwijs en beroepsopleidingen en werkgelegenheid. Ze worden ook ingezet in essentiële particuliere en openbare diensten, zoals de gezondheidszorg en het bankwezen. Verder worden ze toegepast op het gebied van rechtshandhaving, migratie en grensbeheer, justitie en democratische processen, bijvoorbeeld om verkiezingen te beïnvloeden. Deze systemen moeten transparant en nauwkeurig zijn, en de risico’s ervan moeten worden beoordeeld en beperkt. Bovendien moeten in het geval van systemen met een hoog risico logboeken worden bijgehouden en moet menselijk toezicht mogelijk zijn. Burgers hebben het recht om klachten over AI-systemen in te dienen en uitleg te krijgen over beslissingen die zijn genomen op basis van AI-systemen met een hoog risico en die gevolgen hebben voor hun rechten.

Transparantie

AI-systemen voor algemene doeleinden en de modellen waarop ze zijn gebaseerd, moeten voldoen aan bepaalde transparantievereisten, zoals voor de EU-wetgeving over auteursrecht en ze moeten informatie publiceren over de content gebruikt voor trainingen. Voor krachtigere modellen die systeemrisico’s met zich mee kunnen brengen komen er aanvullende vereisten. Denk daarbij aan de uitvoering van modelevaluaties, de beoordeling en beperking van systeemrisico’s, en de rapportage van incidenten.

Daarnaast moeten kunstmatige of gemanipuleerde afbeeldingen, audiobestanden en video-inhoud (deepfakes) duidelijk als zodanig worden aangeduid.

De verordening moet nog een laatste controle door juristen-vertalers ondergaan. De wet moet ook nog formeel worden aangenomen door de Raad van Europa.