Cisco introduceert beveiligingslaag voor AI-agents

Het Amerikaanse technologiebedrijf Cisco heeft tijdens de RSA-conferentie in San Francisco nieuwe beveiligingsfuncties aangekondigd voor AI-agents, die steeds vaker worden ingezet in klantbelevingprocessen. Volgens het bedrijf brengen deze autonome systemen nieuwe risico’s met zich mee, terwijl organisaties moeite hebben om vertrouwen op te bouwen en implementatie op te schalen.

Dit meldt CX Today. AI-agents worden ingezet voor klantinteracties, transacties en backendprocessen. Daarmee verschuift de focus van wat technologie zegt naar wat deze doet. ‘Bij chatbots maakten we ons zorgen over wat ze zouden zeggen. Bij agents maken we ons zorgen over wat ze doen’, zegt Jeff Schultz, Senior Vice President of Portfolio Strategy bij Cisco.

Uit onderzoek van Cisco blijkt dat 85 procent van de zakelijke klanten experimenteert met AI-agents, maar slechts 5 procent deze technologie in productie heeft genomen. Volgens Schultz speelt een gebrek aan vertrouwen hierin een rol.

Concrete maatregelen

Cisco introduceert meerdere beveiligingsopties om dit gat te dichten. Zo krijgen AI-agents een eigen identiteit die gekoppeld is aan een menselijke medewerker. Daarnaast worden Zero Trust Access-controles uitgebreid, zodat agents alleen toegang krijgen tot specifieke systemen en handelingen.

Ook wordt al het verkeer van agents via een zogeheten MCP-gateway geleid om inzicht en controle te vergroten. Nieuwe functies binnen Duo IAM en Cisco Secure Access moeten zorgen voor strikte toegangscontrole en monitoring van intenties en gedrag.

Verder introduceert Cisco tools om agents vóór implementatie te testen, waaronder dynamische red teaming en beveiligingstesten voor modellen en applicaties. Tijdens gebruik worden agents continu gemonitord om risicovol gedrag vroegtijdig te signaleren.

Actiecontrole centraal

Volgens Tom Gillis, Senior Vice President bij Cisco, is een fundamentele verandering nodig: ‘We moeten overstappen op actiecontrole.’ Dit betekent dat niet alleen toegang, maar ook concrete handelingen van agents worden beperkt. ‘De uitdaging is dat als ik een vastgelegde regel schrijf die zegt: “koop geen Porsche”, de agent, die altijd een beetje gretig is, zal zeggen: “oké, prima, dan koop ik een McLaren”’, aldus Gillis.

Cisco introduceert hiervoor onder meer een Agent Runtime SDK, waarmee beveiligingsbeleid direct in workflows wordt geïntegreerd, en een LLM-beveiligingsklassement dat modelrisico’s inzichtelijk maakt.

Impact op klantbeleving

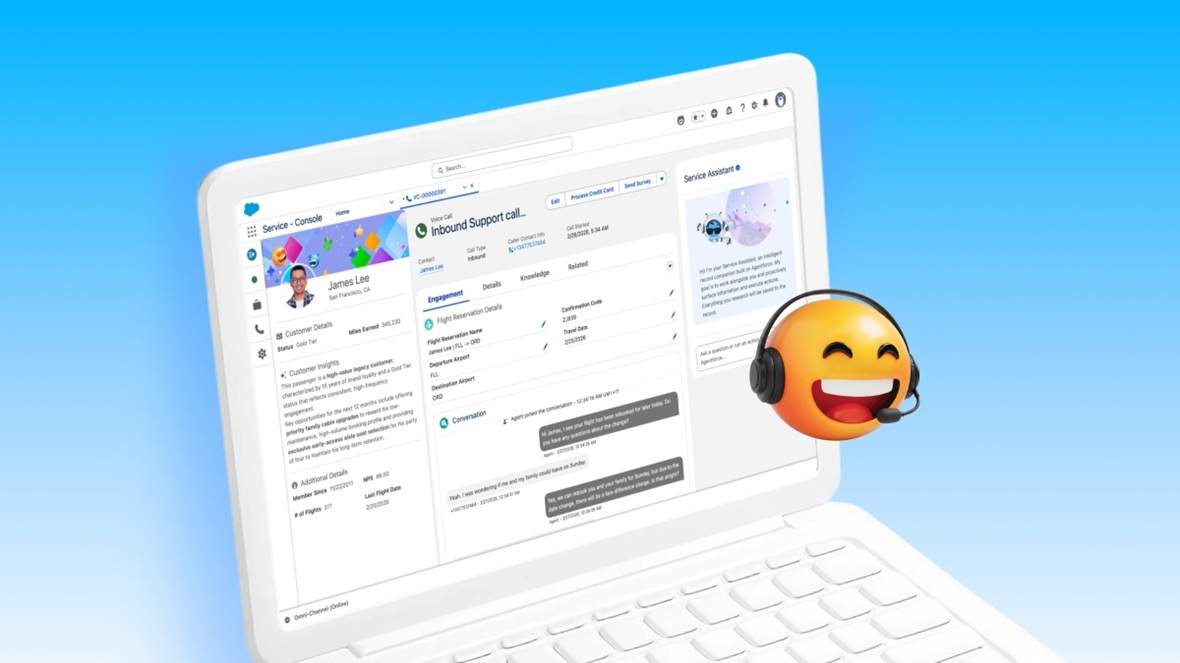

AI-agents functioneren steeds meer als digitale collega’s in klantprocessen. Volgens Cisco kunnen fouten of misbruik direct gevolgen hebben voor klantinteracties en vertrouwen. Door beveiliging te integreren in zowel ontwikkeling als gebruik, wil het bedrijf organisaties helpen AI-agents gecontroleerd in te zetten.

Cisco stelt dat veilige inzet van AI-agents een voorwaarde is om de technologie breder toe te passen. Met de nieuwe beveiligingsfuncties wil het bedrijf het vertrouwen vergroten en adoptie versnellen.